- Поисковые системы

- Практика оптимизации

- Трафик для сайтов

- Монетизация сайтов

- Сайтостроение

- Социальный Маркетинг

- Общение профессионалов

- Биржа и продажа

- Финансовые объявления

- Работа на постоянной основе

- Сайты - покупка, продажа

- Соцсети: страницы, группы, приложения

- Сайты без доменов

- Трафик, тизерная и баннерная реклама

- Продажа, оценка, регистрация доменов

- Ссылки - обмен, покупка, продажа

- Программы и скрипты

- Размещение статей

- Инфопродукты

- Прочие цифровые товары

- Работа и услуги для вебмастера

- Оптимизация, продвижение и аудит

- Ведение рекламных кампаний

- Услуги в области SMM

- Программирование

- Администрирование серверов и сайтов

- Прокси, ВПН, анонимайзеры, IP

- Платное обучение, вебинары

- Регистрация в каталогах

- Копирайтинг, переводы

- Дизайн

- Usability: консультации и аудит

- Изготовление сайтов

- Наполнение сайтов

- Прочие услуги

- Не про работу

Тренды маркетинга в 2024 году: мобильные продажи, углубленная аналитика и ИИ

Экспертная оценка Адмитад

Оксана Мамчуева

посоветуешь локальную модель хорошую?

конкретно из последних использовал UI-TARS и MAI-UI, для специфичного закрывания всплывашек рекламы на мобилках)

из локальных рабочих моделей стоит пробовать запускать qwen 3.5 чем старше тем лучше, или glm5 но она тяжелее сомневаюсь что ноута хватит, все остальное хуже по моим наблюдениям

мой повседневный топ юзфул это codex 5.4, opus 4.6, gemini 3.1, grog 4.2

гоняться и выбирать лучше/дешевле не имеет смысла, через 1-3-6 месяцев все изменится)

мой повседневный топ юзфул это codex 5.4, opus 4.6, gemini 3.1, grog 4.2

Хочу локально развернуть модель для "бедных", кому жаль платить за токены

нормально работающие локальные модели от 70B под rtx6000 96gb, еще куда ни шло, остальное под узкоспецифические задачи, но это все быстро устареет, поэтому не вижу смысла их тестировать

5090 можно взять в аренду за $150/m и там развернуть какой-нибудь дистилированный дипсик, дешевле только апи из логов юзать, но это уже серая тема)

мой вердикт - бери дешевый апи от гугла и ставь ограничение на пользователя по токенам, самый оптимальный и быстрый вариант

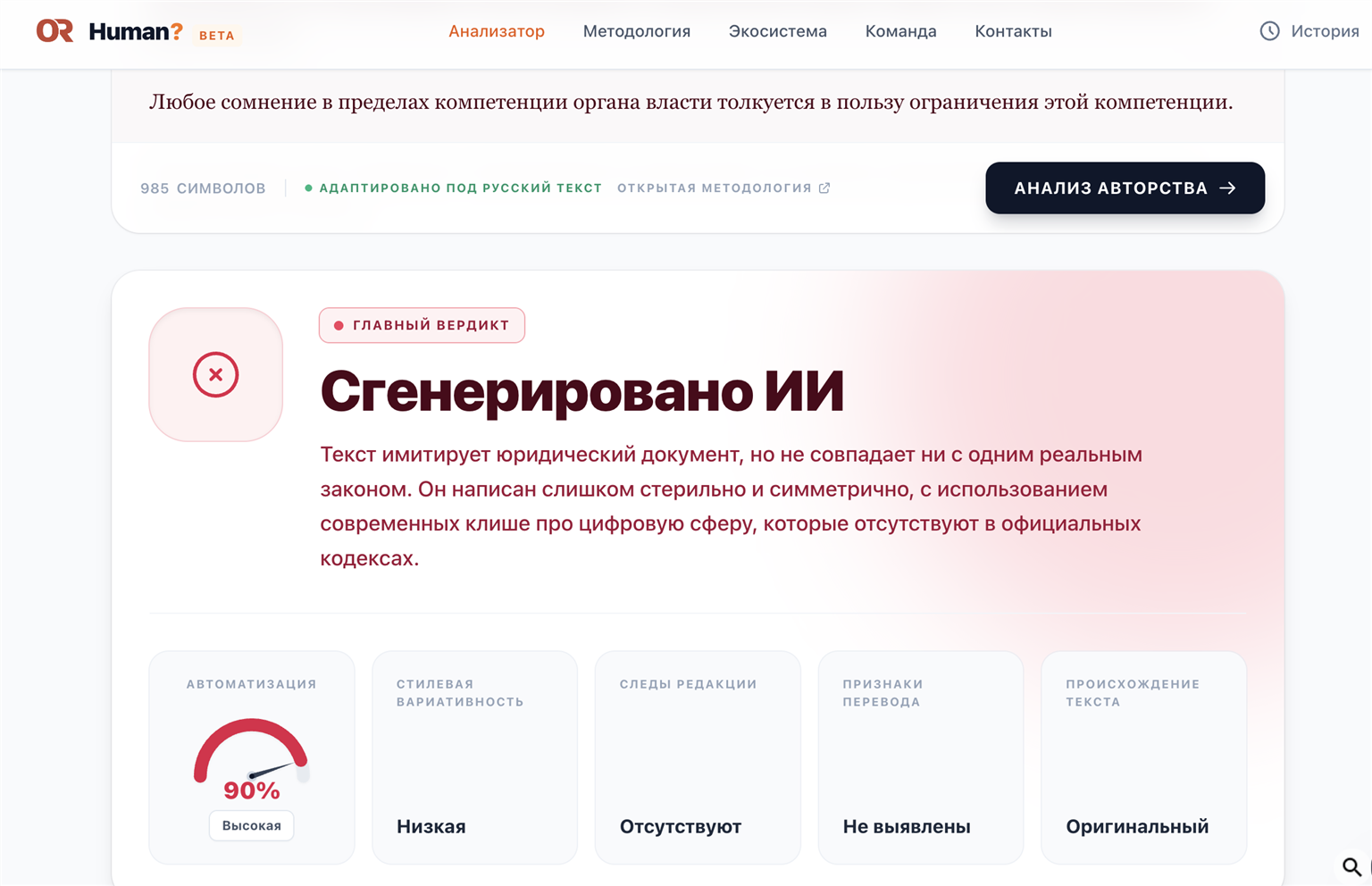

Новый апдейт, определяет реальный юридический текст, или ИИ имитация

Чистое имхо: вы никогда объективно не сможете определить текст как ИИ, имитацию или написанный грамотным копирайтером. Так или иначе, в текстах для веба и медиа есть правила, которые все будут стараться выполнить, что ИИ по промпту, что сам человек, который придерживается этих правил. Выше верно сказали: в качестве анализа "правильного" текста тулза будет сильно полезнее, а в качестве анализатора для выявления ИИ - никогда не будет не то что 100%, а хорошо, если точность останется в районе 60-70%. В общем, полезно, но для других задач.

сейчас в интернете 2 типа детекторов, которые имеют перекос в ИИ, и те которые имеют перекос в "человеческий текст". Мы решили пойти несколько другим путем.

Практический смысл таких анализаторов сомнительный. Поисковикам без разницы, прогнан текст через ИИ или нет. ИИ это неотъемлемая часть человеческой деятельности теперь, и обработка текста через ИИ в основном делает текст лучше, грамотнее во всяком случае.

Нужно делать детектор ПЛОХОГО/ХОРОШЕГО текста, вот и всё. Прямо сейчас мы делаем прототип. Для бизнеса ЭТО то, что надо! Для заказчика типичный ИИ текст и плохой текст, одно и тоже, одинаково бесполезен! Кстати у нас еще есть классический плагиат детектор который показывает техническую уникальность + смысловую уникальность текста, добавленно ли туда какая то ценность или нет, тоже очень полезно. Объеденим ИИ факторы, плагиат, читаемость, обнаружение рерайта, факторы качественного текста, и получится реально практичный инструмент для бизнеса. Важно что написано, а не кем!

Спасибо за Ваш коммент, прямо отозвалось на 100%

Повторюсь-таки.

Сервис определения AI-текстов на основе AI изначально обречён - недетерминированная гадалка не исполнит роль детерминированного судьи...

Нужно делать детектор ПЛОХОГО/ХОРОШЕГО текста

С Вас доля -)

Безусловно, но у нас еще поиск источника и сильная база.