- Поисковые системы

- Практика оптимизации

- Трафик для сайтов

- Монетизация сайтов

- Сайтостроение

- Социальный Маркетинг

- Общение профессионалов

- Биржа и продажа

- Финансовые объявления

- Работа на постоянной основе

- Сайты - покупка, продажа

- Соцсети: страницы, группы, приложения

- Сайты без доменов

- Трафик, тизерная и баннерная реклама

- Продажа, оценка, регистрация доменов

- Ссылки - обмен, покупка, продажа

- Программы и скрипты

- Размещение статей

- Инфопродукты

- Прочие цифровые товары

- Работа и услуги для вебмастера

- Оптимизация, продвижение и аудит

- Ведение рекламных кампаний

- Услуги в области SMM

- Программирование

- Администрирование серверов и сайтов

- Прокси, ВПН, анонимайзеры, IP

- Платное обучение, вебинары

- Регистрация в каталогах

- Копирайтинг, переводы

- Дизайн

- Usability: консультации и аудит

- Изготовление сайтов

- Наполнение сайтов

- Прочие услуги

- Не про работу

Как удалить плохие SEO-ссылки и очистить ссылочную массу сайта

Применяем отклонение ссылок

Сервис Rookee

а где же тут клоака ?

Не знаю, я сайт не смотрел, к чему пример то был?

Учитывает и вполне успешно. Он сначала страницу хавает с этой меткой и следующим апом выкидывает

У вас выводы неправильные. Если бы учитывал, то не выкидывал, для того чтобы учесть дубль

Не знаю, я сайт не смотрел, к чему пример то был?

Там сайт под гугл на всю рф и ему срать на яндекс

Да мне тоже не очень нравится, из эстетических соображений. :)

rel=“next|prev куда логичнее.

А если изучать вопрос передачи весов страниц, тот самый пейдж ранк или вИЦ. Можно далеко уйти...

Гугл больше не поддерживает rel=“next|prev

https://support.google.com/webmasters/thread/2842024?hl=ru - вопрос от 3 марта 2019

Чего не понял?

Боту надо показывать только то, что ему следует индексить, а не лечить костылями.rel.canonical ляпы cms

и не расходовать т.н. краулинговый бюджет на скачивание лишних страниц.

Страницы пагинации дублями обычно не являются, поэтому не надо использовать костыль.rel.canonical не по назначению, он задуман именно для дублей...

всегда закрывал от индекса пагинацию. Спорить не буду, у всех есть статистики по своим сайтам и пускай туда смотрят.

«всегда» — вас не было.

Попобуйте изобрести смысл исключения из выдачи/индекса страниц типа:

/ru/forum/optimization-practices/common

/ru/forum/optimization-practices/common

/ru/forum/optimization-practices/common

кроме проспама голов словом «пагинация», реальных причин может и не быть

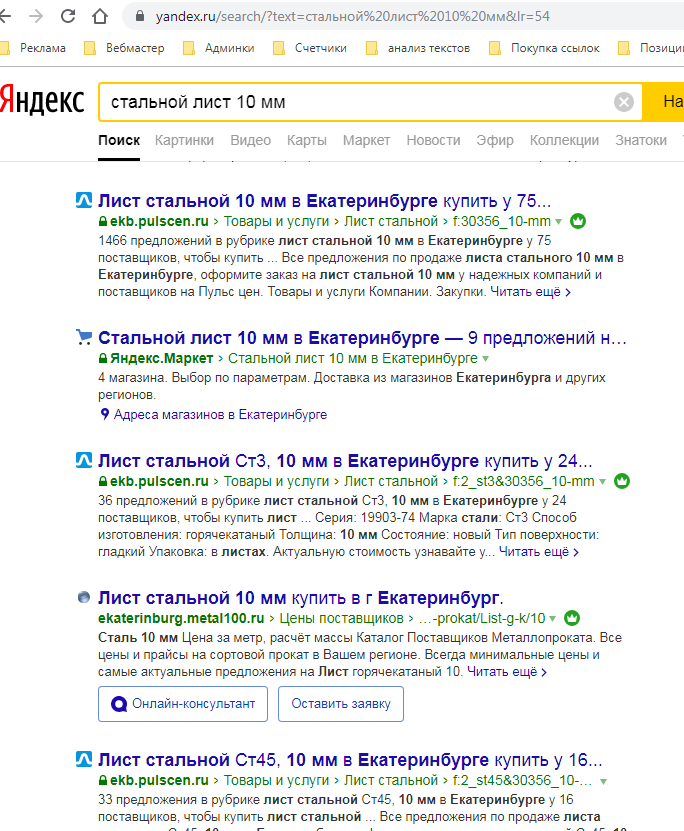

да у яндекса определенно пару месяцев приступ любви к фильтрам, в том числе и слегка бессмысленным. боюсь отображение нескольких результатов обеспечен зелеными значками. и это вытесняет коммерческие сайты из выдачи, оставляя агрегаторы и информационники. и интерес понятен - агрегаторы же не тащат бабок в директ, а наоборот вытаскивают их из директа

Сегодня проверил многих конкурентов, занимающих ТОП по основным запросам. На страницы пагинации помимо rel canonical они ставят meta "noindex" или "noindex, follow".

Правильное ли это решение?

Неправильным решением является попытка сделать как у них, не понимая смысла действий.

Ну не хотят индексить пагинацию... а вдруг они говнобложиков наелись.

Не, на них точно сео компании работают.

Да и чего в пагинации нужного? Только ссылки на товары, а переход по ссылкам при noindex follow разрешен.

А Вы как считаете?